La Cina è stata colta di sorpresa dall'arrivo delle intelligenze artificiali generative. Ma ha un piano chiaro per riprendersi: superare i problemi di censura, puntare sulle tecnologie applicate e diventare il Paese leader del settore.

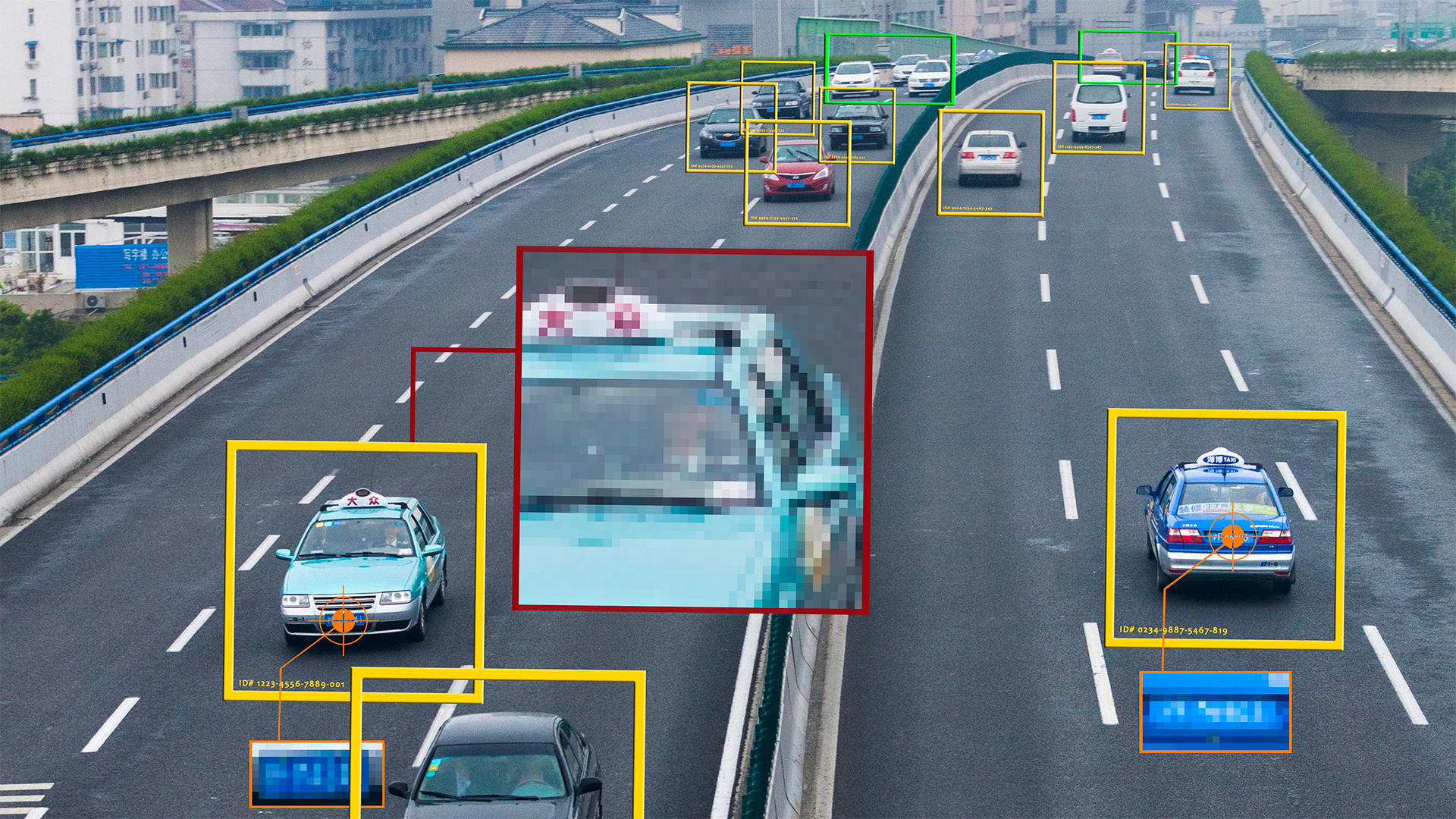

La Cina sta procedendo a grandi falcate nella sua rincorsa tecnologica agli Stati Uniti. Nella Repubblica Popolare è ormai normale essere assistiti da robot intelligenti all’interno di banche, ospedali, ristoranti. I pagamenti digitali sono sempre più spesso automatizzati tramite il riconoscimento facciale basato su intelligenza artificiale, e questa stessa tecnologia è largamente impiegata a scopi di sicurezza, nelle scuole e sul luogo di lavoro.

Anche se non ci sono informazioni certe a causa della coltre di segretezza che ne circonda lo sviluppo, si pensa che la Cina sia stata anche la prima nazione a sviluppare supercomputer exascale, in grado di eseguire un miliardo di miliardi di calcoli al secondo, oltre ad aver raggiunto importanti traguardi nell’avveniristico campo dei brain data – dati raccolti direttamente dal cervello degli esseri umani e impiegati per aumentarne l’efficienza –, nei computer quantistici e in una marea di altri settori ad altissimo tasso di innovazione.

D’altra parte, l’obiettivo ufficialmente annunciato dal partito nel 2017 prevede che la Cina diventi la nazione leader nel campo dell’intelligenza artificiale (e non solo) entro il 2030. Gli investimenti in ricerca e sviluppo sono stati aumentati, a questo scopo, del 7% annuo.

Ma non tutto, fin qui, è andato come previsto. Il 30 novembre 2022, dagli Stati Uniti è piombato ChatGPT, che ha dato ufficialmente il via alla rivoluzione dei large language model e delle intelligenze artificiali generative: sistemi in grado di generare testi, immagini, musica e video rispondendo a un comando formulato in linguaggio naturale. La Cina è stata colta alla sprovvista dalla rapidissima diffusione di questi software (che si sono subito moltiplicati: Gemini di Google, Llama di Meta e i vari Midjourney, Dall-E, ecc.), e ha impiegato mesi per rispondere agli Stati Uniti e rilasciare dei modelli che rimangono però nettamente al di sotto delle aspettative.

Praticamente da un giorno all’altro, la Cina si è trovata di nuovo a rincorrere. Perfino il ministro della Scienza e della Tecnologia cinese ha riconosciuto le difficoltà, ammettendo che la Repubblica Popolare ha “ancora molto lavoro da fare” per ottenere risultati simili a quelli di OpenAI (la società che produce ChatGPT).

Le ragioni di questo passa falso, ovviamente, sono molte. E riguardano in parte, come vedremo più avanti, la predilezione cinese per sistemi di intelligenza artificiale che hanno applicazioni più concrete e specifiche. Eppure, dietro alle difficoltà di sviluppo di un’intelligenza artificiale generativa cinese, ci sono anche motivi di natura esclusivamente politica: per un regime autoritario in cui molti temi e argomenti pubblici sono ancora severamente filtrati dalle maglie della censura, i large language model rappresentano una pericolosa arma a doppio taglio. Prendiamo ad esempio quanto è avvenuto lo scorso ottobre: il sistema sviluppato dalla cinese iFlyTek – un modello linguistico che assiste gli studenti nei loro compiti a casa – ha generato dei paragrafi in cui erano contenute delle critiche a Mao Zedong. Appena la notizia ha iniziato a circolare sui social, le azioni di iFlyTek sono precipitate del 10% e lo staff responsabile dello sviluppo del sistema “è stato punito” (testuali parole del CEO Liu Qingfeng).

E non è l’unico caso: nel febbraio 2023, la società Yuanyu Intelligence ha dovuto disattivare in fretta e furia il suo chatbot ChatYuan (lanciato solo da pochi giorni) dopo che aveva definito il conflitto in Russia una “guerra di aggressione” – in contrasto con la terminologia impiegata dal partito, che si guarda dall’assegnare troppe colpe a Putin – e aveva poi sollevato dubbi sulle prospettive economiche della Cina. Due episodi che mostrano chiaramente quali sono i rischi insiti in una tecnologia che genera contenuti in maniera spesso imprevedibile.

La domanda a cui, in Cina, stanno cercando risposta, a questo punto è una: è possibile sviluppare un large language model che sia aderente al 100% alla dottrina cinese e che non compia quindi mai variazioni politicamente pericolose?

Per rispondere a questa domanda, bisogna partire dal funzionamento dei large language model: sistemi basati su deep learning (l’algoritmo statistico che consente ai software di svolgere compiti specifici in maniera autonoma e che è ormai, da qualche anno, sinonimo di intelligenza artificiale). Parliamo quindi di sistemi che imparano a generare contenuti dopo essere stati addestrati su un’enorme mole di testi. Nel caso di GPT-3, il modello linguistico di OpenAI (che alimenta la prima versione di ChatGPT) è stato addestrato impiegando tutti i testi presenti nella versione in lingua inglese di Wikipedia, l’intero archivio di Reddit, un’enorme quantità di articoli pescati nel web e molto altro ancora.

Dal momento che anche alcuni chatbot cinesi sono stati addestrati, a loro volta, con testi in lingua inglese (è il caso di Ernie di Baidu) e poiché è impossibile filtrare accuratamente una tale mole di dati, un sistema di questo tipo – per tornare al nostro esempio – può imparare a definire il conflitto in Ucraina una “guerra di aggressione” invece che una “operazione speciale” (come preferiscono Putin e Xi Jinping) o a sollevare dubbi sulla prosperità economica cinese attingendo informazioni da qualche articolo critico.

Neanche impiegare solamente testi di origine cinese e provenienti esclusivamente da fonti approvate dal partito potrebbe mettere al riparo dai rischi. Questi modelli, infatti, si limitano a prevedere statisticamente quale parola abbia la maggiore probabilità di essere coerente con quelle che l’hanno preceduta, sempre facendo affidamento al dataset tramite il quale sono stati addestrati. Nel corso dei calcoli statistici che sono alla base del loro funzionamento (come di tutti gli algoritmi di deep learning) qualcosa può però sempre andare storto, portando ad affermazioni imprevedibili, sbagliate o completamente prive di senso: “Fare in modo che un chatbot segua le regole nel 90% dei casi è abbastanza facile”, ha spiegato su «Foreign Policy» lo scienziato informatico di Harvard Yonadav Shavit. “Ma riuscire a fargli seguire le regole nel 99,99% dei casi è un enorme problema di ricerca ancora irrisolto”.

“Nella Repubblica Popolare è ormai normale essere assistiti da robot intelligenti all’interno di banche, ospedali, ristoranti”.

Considerando i rischi che corrono le aziende i cui chatbot producono contenuti non in linea con i dettami del partito, non c’è il pericolo che le principali società agiscano con eccessiva prudenza, che rinuncino direttamente a sviluppare sistemi per loro natura imprevedibili o che un dataset troppo rigidamente filtrato e ridotto dia vita a large language model dalle prestazioni scarse?

“È certamente un ostacolo, ma non credo che rappresenti una preoccupazione eccessiva per le società cinesi”, spiega però Simone Pieranni, giornalista esperto di Cina e autore di Tecnocina (da poco pubblicato da add). “Molte delle principali aziende tecnologiche hanno a disposizione grandi quantità di dati sicuri e sono gestite da manager che conoscono bene il terreno sul quale si muovono. In più, mi sembra che il partito non abbia tutta questa intenzione di spingere sull’intelligenza artificiale generativa. Dovrà farlo, anche per una questione di immagine, ma la priorità è su sistemi d’intelligenza artificiale tradizionale, che siano utili a rendere lo stato cinese più efficiente, per esempio razionalizzando il sistema sanitario o aumentando la potenza militare”.

Pur dando la priorità a questi sistemi più tradizionali (quindi intelligenze artificiali non generative e dalle applicazioni più concrete), la Cina sta comunque testando alcune delle opportunità offerte dai large language model, sperando che – se addestrati con il giusto dataset e impiegati per scopi chiaramente definiti – possano essere un alleato, più che un nemico, della propaganda. Una dimostrazione di tutto ciò è il recentissimo lancio del chatbot Xue Xi, progettato per diffondere l’ideologia politica del presidente Xi Jinping. Xue Xi (che significa “studiare Xi”) è “un emissario digitale del pensiero di Xi Jinping: una dottrina che contiene i 14 principi volti a cementificare il potere assoluto del partito, a rafforzare la sicurezza nazionale e a promuovere i valori socialisti”.

Come spiega «The Diplomat», Xue Xi è stato sviluppato dalla prestigiosa Università Tsinghua di Pechino e permette agli utenti di avere discussioni relative alla gestione politica, al socialismo e alla necessità di ringiovanire la nazione. Addestrata attraverso sette dataset attentamente selezionati dalla China Cyberspace Administration, Xue Xi è la dimostrazione di come l’intelligenza artificiale generativa possa ancora giocare un ruolo importante all’interno della strategia comunicativa digitale varata da Xi Jinping nel 2019, con l’obiettivo di propagare la sua ideologia anche tramite app, quiz e materiale educativo.

In poche parole, mentre le società occidentali si occupano di spingere al limite ciò che l’intelligenza artificiale generativa può ottenere grazie anche a dataset enormi e quanto più vari possibile, i colossi cinesi – comprese le più importanti realtà nazionali, come Baidu o Alibaba – devono sviluppare modelli apparentemente più semplici, e rigidamente allineati alla volontà del partito.

Rinunciare completamente allo sviluppo di un ChatGPT made in China non è però una strada praticabile: non solo per le potenzialità economiche comunque significative (secondo Goldman Sachs è un campo che potrebbe aumentare il prodotto interno lordo globale del 7% nel giro dei prossimi dieci anni), ma soprattutto perché una privazione del genere sarebbe una sconfitta nella gara contro gli Stati Uniti e una dimostrazione di come le democrazie siano, almeno in alcuni casi, intrinsecamente avvantaggiate dal punto di vista tecnologico, non essendo soggette alla pesante censura che ostacola lo sviluppo dei large language model.

La Cina rimane così ancora interessata a sfruttare le potenzialità dei sistemi generativi, come dimostrato dal lancio di Kling, il nuovo sistema text-to-video – che genera cioè video rispondendo a comandi scritti – prodotto da Kuaishou. E questo anche per il contributo che questo tipo di tecnologie possono dare alla crescita generale del mercato interno dell’intelligenza artificiale, che oggi vale 14 miliardi di dollari (contro i 50 miliardi degli Stati Uniti), ma che si punta a far crescere di dieci volte entro il 2030.

Non sarà un’impresa facile trovare il giusto equilibrio tra innovazione e sicurezza. Ma, come ha sintetizzato lo storico della tecnologia John Naughton, “se sono riusciti a tenere sotto controllo internet, possono riuscire a tenere sotto controllo anche l’intelligenza artificiale generativa”.

In secondo luogo, come racconta Pieranni, le aziende cinesi sono ormai molto abili nel muoversi tra le restrizioni imposte dalla politica, che a sua volta si sta impegnando per fornire alle società un quadro normativo che permetta di sviluppare sistemi, generativi e non, che siano contemporaneamente sicuri a livello politico e potenti a livello tecnologico.

Un quadro normativo, oggi ancora a livello di bozza, a cui sta lavorando il governo (tramite l’Amministrazione del cyberspazio cinese) e che nel mondo occidentale ha sollevato anche alcune ironie, soprattutto per la parte in cui è richiesto che i sistemi di intelligenza artificiale “aderiscano ai valori socialisti”. Ha senso una richiesta del genere? Può un’intelligenza artificiale aderire a dei valori politici?

“Questo elemento relativo ai valori fondanti del socialismo viene inserito praticamente ovunque”, prosegue Pieranni. “Anche quando ci fu la legge contro gli algoritmi di raccomandazione, al suo interno c’era l’invito a valorizzare il socialismo. Potremmo tradurre questa richiesta con la famosa espressione di Xi Jinping relativa alla necessità di parlare bene della Cina. Insomma, più che sul socialismo, l’accento è posto sul mettere in evidenza gli aspetti positivi del Paese e non mostrare quelli negativi. In sintesi, è una sorta di chiamata all’autocensura”.

Un altro interessante e delicato aspetto della bozza – la cui stesura definitiva dovrebbe giungere entro la fine di quest’anno – riguarda la necessità di eseguire valutazioni di sicurezza nei confronti di tutti i servizi dotati di “capacità di mobilitazione sociale” e che possono avere un impatto sull’opinione pubblica.

“Mentre le società occidentali si occupano di spingere al limite ciò che l’intelligenza artificiale generativa può ottenere grazie anche a dataset enormi e quanto più vari possibile, i colossi cinesi devono sviluppare modelli apparentemente più semplici, e rigidamente allineati alla volontà del partito”.

Le modifiche apportate nel tempo alla bozza normativa hanno mostrato però come la Cina, pur di non restare indietro, sia comunque disposta a correre qualche rischio. Per esempio, una prima versione richiedeva agli sviluppatori di aggiornare i modelli entro tre mesi dal momento in cui venivano a sapere che determinati contenuti erano stati vietati. Una clausola onerosa, perché avrebbe richiesto la messa a punto di algoritmi incredibilmente complessi con una frequenza ben superiore al normale ciclo di sviluppo, solo per garantire una maggiore sicurezza. In una versione più recente, questo passaggio è stato cancellato e sostituito da richieste più flessibili, a livello sia temporale, sia tecnologico. Allo stesso modo, la richiesta iniziale di “impedire le informazioni false” è stata sostituita con quella di “limitare le informazioni false dannose”. Una modifica che mostra come, da parte della politica, ci sia consapevolezza della propensione di questi sistemi a essere vittime talvolta di risultati imprevedibili o, come si dice in gergo, di “allucinazioni”, e come per le aziende sia impossibile evitare del tutto che ciò si verifichi.

Secondo l’organo ufficiale «Global Times», l’obiettivo del governo è ora quello di “offrire un approccio corretto, aperto e inclusivo allo sviluppo, alla sicurezza e alla gestione dei servizi e delle tecnologie emergenti basate su intelligenza artificiale, in netto contrasto con le restrizioni e i blocchi imposti dagli Stati Uniti al fine di preservare la propria egemonia” (e questo è un chiaro riferimento alle sanzioni relative soprattutto ai microchip, fondamentali per lo sviluppo delle intelligenze artificiali). La Cina, tramite la sua Global Artificial Intelligence Governance Initiative, ha insomma fatto sua l’ambizione di fornire linee guida che vengano poi emulate a livello internazionale (soprattutto all’interno della sfera di influenza cinese). Approfitta così della totale assenza di norme complessive provenienti dagli Stati Uniti (che stanno per ora seguendo il loro classico approccio “laissez-faire” allo sviluppo tecnologico, prima di intervenire), e dell’inadeguatezza dell’AI Act europeo, principalmente incentrato sulle priorità della difesa della privacy e dagli abusi della sorveglianza digitale.

La Cina, adesso, mira quindi alla governance dell’intelligenza artificiale con un approccio di respiro internazionale (proprio a questo scopo ha da poco varato il National Data Bureau, con l’obiettivo, scrive sempre il «Global Times» di “coordinare l’integrazione, la condivisione, lo sviluppo e l’utilizzo dei dati” per queste tecnologie, e di “attivare un mercato dei dati, che permetta di realizzare in pieno il loro valore” a livello globale). Per questo, secondo «The Diplomat», “anche se la Cina non supererà gli Stati Uniti nello sviluppo dei più innovativi modelli d’intelligenza artificiale, le sue applicazioni possono comunque avere un importante impatto sul panorama geopolitico”.

Integrando l’intelligenza artificiale in aree come la biotecnologia, l’ingegneria industriale e la sicurezza – e sviluppando sistemi certificati e affidabili anche per altre nazioni autocratiche – Pechino vuole poi esportare i propri sistemi. “Ciò non solo contribuirà a diffondere il modello di governance cinese, ma consoliderà anche la sua influenza nelle regioni che si oppongono agli ideali occidentali”, si legge sempre su «The Diplomat».

In questo senso, l’aspetto “generativo” dell’intelligenza artificiale passa effettivamente in secondo piano rispetto a sistemi bellici, di sorveglianza, di automazione della pubblica amministrazione. Forse non esisterà mai un ChatGPT o un Gemini cinese (almeno non di pari livello), ma questo non significa che la Cina sia destinata a restare indietro nel campo più generale dell’intelligenza artificiale. La Cina sembra avere le idee molto chiare su quali siano i suoi punti di forza. E sa bene come sfruttarli nell’ormai decennale sfida tecnologica agli Stati Uniti.